Von Thorsten Reuters

Wenn Sie in letzter Zeit das Gefühl haben, dass Suchergebnisse und Social-Media-Feeds zunehmend mit unsinnigen Geschichten, bizarren KI-generierten Bildern und sich wiederholenden „Nachrichten“ überflutet werden, dann sind Sie auf ein Phänomen gestoßen, das mittlerweile offiziell als „AI Slop“ bekannt ist.

„AI Slop“ wurde kürzlich von großen Wörterbüchern zum „Wort des Jahres“ gekürt und ist zum Äquivalent von E-Mail-Spam im Jahr 2026 geworden – allerdings weitaus trügerischer und schwerer zu ignorieren.

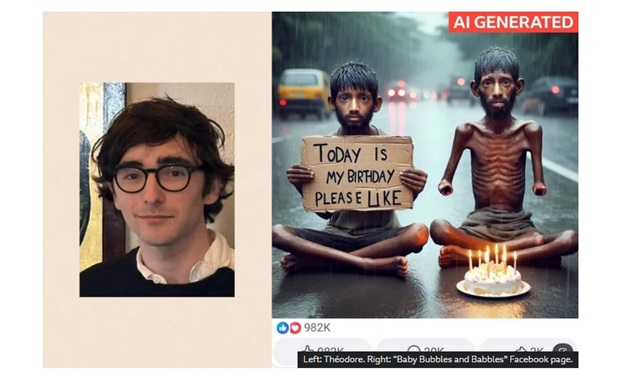

„Es hat mich umgehauen. Die absurden KI-Bilder waren überall auf Facebook zu sehen und erhielten ohne jegliche Überprüfung enorme Aufmerksamkeit – für mich war das Wahnsinn“, sagt Théodore Cazals, ein 20-jähriger Student aus Paris, in einem Interview mit der bbc.

Also eröffnete Théodore einen Account auf X, früher bekannt als Twitter, namens „Insane AI Slop“ und begann, Inhalte, die er fand und die Menschen täuschten, anzuprangern und sich darüber lustig zu machen. Andere wurden darauf aufmerksam, und sein Posteingang wurde bald mit Einsendungen von beliebten sogenannten AI Slops überflutet.

„Kinder in der Dritten Welt, die beeindruckende Dinge tun, sind immer beliebt – wie ein armes Kind in Afrika, das aus Müll eine verrückte Statue baut. Ich glaube, die Leute finden das gut, also denken die Macher: ‚Super, lasst uns mehr davon machen‘“, sagt Théodore.

Die Flut von KI-Schund – den er als gefälschte, wenig überzeugende Videos und Bilder definiert, die schnell produziert werden – ist mittlerweile nicht mehr aufzuhalten. Tech-Unternehmen haben sich die KI zu eigen gemacht. Einige der Firmen geben an, dass sie beginnen, gegen bestimmte Formen von KI-„Schund“ vorzugehen – obwohl viele Social-Media-Feeds immer noch voll davon sind.

Was genau ist „AI Slop“?

Kurz gesagt ist „AI Slop“ minderwertiger, unüberprüfter und oft halluzinierter Inhalt, der von künstlicher Intelligenz mit wenig bis gar keiner menschlichen Aufsicht generiert wird. Im Gegensatz zu hochwertigem KI-gestütztem Journalismus wird „Slop“ massenhaft von sogenannten Content-Farmen produziert.

Ihr einziges Ziel: ein gutes Ranking bei Google und in sozialen Medien zu erzielen, um Werbeeinnahmen durch „programmatische Anzeigen“ zu erzielen – jene sensationellen „Empfehlungen für Sie“-Boxen am Ende vieler Websites.

Die Epstein-Fallstudie: Eine Goldgrube für „Slop“-Ersteller

Ein perfektes Beispiel dafür, wie diese Branche funktioniert, ist die kürzlich veröffentlichte 3 Millionen Seiten umfassende Epstein-Dokumentensammlung.

Während seriöse Redaktionen Wochen oder Monate damit verbringen, diese komplexen Rechtsdokumente akribisch zu indexieren und zu überprüfen, generieren „AI Slop“-Fabriken innerhalb von Minuten Hunderte von „exklusiven“ Listen.

Diese Listen bringen oft prominente Persönlichkeiten oder Politiker fälschlicherweise mit dem Skandal in Verbindung – nicht auf der Grundlage von Fakten, die in den Dokumenten zu finden sind, sondern auf der Grundlage dessen, was die KI für die meisten Klicks hält.

Die Ökonomie der Fehlinformationen

Warum geschieht das? Es ist ein Zahlenspiel. Berichte von Medienbeobachtern wie NewsGuard deuten darauf hin, dass eine einzige „Slop“-Website bis zu 40.000 Dollar pro Monat an Werbeeinnahmen generieren kann. Indem sie das Internet täglich mit Tausenden von KI-geschriebenen Artikeln überschwemmen, brauchen diese Betreiber nur einen Bruchteil davon, um viral zu gehen und massive Gewinne zu erzielen.

Wie man „KI-Slop“ erkennt (die 5-Punkte-Prüfung)

Um sich vor digitalem Müll zu schützen, achten Sie auf folgende Warnsignale:

Vage Überschriften: Verspricht der Artikel eine „schockierende Liste“, ohne eine bestimmte Seite oder Quelle im Dokument zu nennen? Sich wiederholende Formulierungen: KI verwendet oft zirkuläre Logik und sagt dasselbe dreimal auf leicht unterschiedliche Weise.

Fehlende Autorenbiografie: Die meisten „Slop“-Websites haben kein echtes Redaktionsteam, keine physische Adresse und keine Geschichte des investigativen Journalismus.

Der „Halluzinationsfaktor“: Achten Sie auf bestimmte Namen, die in der Überschrift erscheinen, aber im eigentlichen Text nie erklärt oder belegt werden.

Bizarre Bilder: Seien Sie vorsichtig bei Artikeln, die mit hyperrealistischen, aber leicht „verzerrten“ KI-Bildern illustriert sind (achten Sie auf verzerrte Hände oder unsinnige Hintergrunddetails).

Die Zukunft der Online-Informationen

Da das Internet zunehmend mit „Slop“ übersättigt ist, steigt der Wert von menschlich kuratierten und faktengeprüften Nachrichten. KI ist zwar ein leistungsstarkes Werkzeug, aber die schiere Menge an automatisierten Fehlinformationen im Jahr 2026 macht deutlich, dass Technologie allein das kritische Auge des traditionellen Journalismus nicht ersetzen kann. Kontext, Ethik und das Gewicht der Wahrheit bleiben die einzigen wirksamen Filter gegen den digitalen Lärm.

AUCH INTERESSANT

– Epstein-Akten –

Hollywood: Tom Hanks und die Epstein-Akten

Nach der Veröffentlichung von rund 3,5 Millionen Dokumenten im Zusammenhang mit den Ermittlungen des US-Justizministeriums gegen Jeffrey Epstein im Januar und Februar 2026 wurden die sozialen Medien mit Behauptungen über prominente Persönlichkeiten überschwemmt.